La reciente colisión entre el Gobierno de España y los tecno-oligarcas propietarios de grandes plataformas digitales no es un simple desacuerdo técnico sobre regulación. Es, en realidad, un conflicto de soberanía.

Cuando el presidente Pedro Sánchez anunció en Dubái un paquete de medidas para reforzar el control público sobre las redes sociales —protección de menores, responsabilidad de las plataformas y posible persecución de directivos— la respuesta no llegó por cauces diplomáticos ni jurídicos. Llegó directamente a millones de ciudadanos, desde sus móviles, firmada por los dueños de las propias plataformas.

Ahí está la clave del problema: ¿qué son hoy X o Telegram?

Formalmente, redes sociales privadas.

Materialmente, infraestructuras de comunicación política con capacidad de alterar la opinión pública de países enteros.

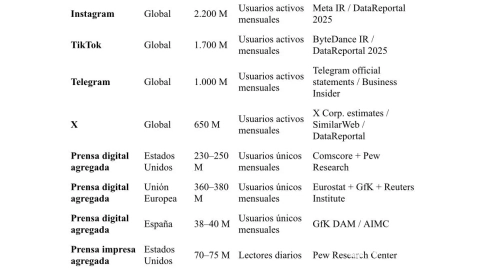

Alcance comparado de plataformas digitales y prensa agregada

(datos aproximados 2025-2026)

Una sola plataforma privada (Instagram, TikTok o Telegram) supera en alcance mensual a toda la prensa digital de Estados Unidos, Europa o España. Y, de hecho, X (antes Twitter) o Telegram, individualmente, alcanzan a más ciudadanos que todo el ecosistema de prensa español.Y, sin embargo, la prensa tiene que asumir responsabilidad editorial directa sobre todo lo que se publica, y las plataformas tan sólo responsabilidad jurídica limitada.

X y Telegram: redes sociales de iure, medios de comunicación de facto

El argumento es incómodo pero difícil de refutar: X y Telegram cumplen hoy funciones estructurales propias de un medio de comunicación, pero sin someterse a las reglas que rigen a estos.

- Distribuyen información política a gran escala

- Jerarquizan contenidos mediante algoritmos opacos

- Permiten (o impulsan) campañas de presión, descrédito o movilización

- Tienen capacidad de marcar agenda pública en tiempo real

La diferencia esencial es que no asumen responsabilidad editorial, pese a que sus decisiones técnicas producen efectos editoriales claros.

Cuando Elon Musk, propietario de X, califica públicamente a un presidente europeo como Pedro Sánchez de “tirano” y “traidor”, tras referirse a él como “Dirty Sanchez”, no lo hace como un usuario más: lo hace desde la cúspide del sistema de amplificación, con un alcance que ningún director de periódico europeo posee hoy, un tuit con 38 millones de impactos dirigido al presidente de un Gobierno con una población de 49,4 millones de personas.

Dirty Sánchez is a tyrant and traitor to the people of Spain 💩 https://t.co/B3oyHrBYpR

— Elon Musk (@elonmusk) February 3, 2026

Del mismo modo, cuando Telegram envía mensajes directos a sus 8 millones de usuarios en España alertando contra medidas gubernamentales, está ejerciendo comunicación política directa, sin intermediarios ni controles democráticos.

El tecnofeudalismo digital: poder privado, impacto público

Este fenómeno encaja en lo que varios autores denominan tecnofeudalismo:

un sistema en el que infraestructuras privadas globales ejercen funciones que antes correspondían al espacio público, sin control equivalente.

Los rasgos son claros:

- Concentración extrema de poder comunicativo en manos de muy pocos actores.

- Dependencia social masiva de esas plataformas para informarse, debatir y organizarse.

- Asimetría regulatoria: los Estados (y los medios) responden a leyes, las plataformas a términos de uso.

- Capacidad de presión política directa sobre gobiernos democráticos.

Agentes políticos y fake news

En este contexto, Musk o los fundadores de grandes plataformas no actúan solo como empresarios, sino como actores políticos no electos, capaces de influir en procesos nacionales sin rendir cuentas ante los ciudadanos afectados.

En el caso de X, propiedad del hombre más rico del mundo, Elon Musk, el patrón de la plataforma favorece la amplificación y el diseño de bulos y fake news y facilitan las suplantaciones. Por ejemplo, en las elecciones de Estados Unidos que ganó Donald Trump, un informe del Center for Countering Digital Hate señaló que afirmaciones demostradamente falsas de Musk sobre el proceso electoral (probadas por los fact-checkers) obtuvieron en torno a 2.000 millones de visualizaciones en X, de las 17.000 millones que produjeron los mensajes del magnate, más del doble de las notificaciones políticas de demócratas y republicanos juntas.

Otro ejemplo de injerencia y propaganda fueron las piezas falsas para desacreditar a la USAID, desde el video “noticioso” generado con IA, que fue reposteado por Musk y acumuló más de 4 millones de visualizaciones, pese a estar desmentido, a la campaña subsiguiente contra esta organización benéfica. Junto a ese bulo, se difundieron activamente desinformaciones sobre los 50 millones de esta organización en “condones para Hamas” (eran fondos para prevenir el SIDA en la Gaza situada en Mozambique, no en Palestina), los 32.000 dólares para financiar un comic “transgénero” en Perú (67 millones de visualizaciones del post falso de Musk, cuando en los comics no sale ninguna persona trans), los 8 millones en que transformaron los 42.000 dólares para suscripciones a la publicación Político, o el bulo de que USAID pagó a famosos para apoyar a Zelenski.

La Comisión Europea multó a X con 120 millones de euros por incumplimientos de transparencia (entre ellos el sistema de verificación que puede inducir a confusión y facilitar engaños y suplantación), además de otros fallos de transparencia y acceso a datos.

Associated Press documentó cómo X fue señalado por expertos como especialmente problemático en la difusión de contenidos engañosos durante el genocidio de Israel en Gaza, impulsados por dinámicas de viralidad e incentivos gestionados por la propia plataforma. Directamente, amplifican los bulos en cuentas verificadas porque son más rentables.

Básicamente, no es solo que se publiquen constantemente bulos en la red social, con el concurso activo de su propietario; es que la arquitectura (algoritmo + verificación + monetización) premia el contenido falso y lo hace escalar.

Nudificación y deepfakes porno: Violencia digital contra mujeres y menores

Al problema de la difusión extrema de desinformación, malinformación y bulos se le unen los deepfakes sexuales creados por IA que provocan violencia sexual contra mujeres y menores. UNICEF ha documentado en febrero de 2026 que al menos 1,2 millones de niños en 11 países tuvieron sus imágenes manipuladas en el último año para crear contenido sexualizado mediante IA y difundirlo por plataformas como Telegram o X.

Thorn y Burson cifraron en 2025 en 1 de cada 6 jóvenes entre 13 y 20 años los que dijeron conocer a alguien que, siendo menor, estuvo expuesto a experiencias relacionadas con desnudos deepfake, y Columbia recogió en 2024 que el contenido deepfake online es mayoritariamente pornográfico y que los objetivos son de forma abrumadora mujeres.

La proliferación de estas campañas ha provocado el 6 de febrero de este año que Reino Unido activara una ley que criminaliza la creación de imágenes sexuales deepfake no consentidas (y el debate regulatorio se está acelerando). El problema principal de la regulación existente es que no afecta a las plataformas que amplifican los mensajes, sino solo al autor material de estas violencias sexuales, que muchas veces se esconde bajo el anonimato permitido por las plataformas.

También este mes de febrero, se ha activado una investigación en Francia vinculada a X y al uso de su chatbot para contenido sexual explícito deepfake, incluyendo alegaciones relacionadas con material de abuso infantil. Francia ha sido uno de los países, junto a Alemania, que ha mostrado apoyo explícito al presidente del Gobierno de España, Pedro Sánchez, en sus medidas anunciadas de protección a los menores y regulación de las plataformas.

La “IA para desnudar” ha bajado el coste del daño a casi cero, y eso industrializa el abuso: se replica, se redistribuye y se usa para acoso, extorsión o humillación. Con la aquiescencia de unas plataformas que no responden legalmente a su responsabilidad subsidiaria.

La marea de fondo radica en la sextorsión: en 2024, el CyberTipline del NCMEC (Estados Unidos) recibió más de 20,5 millones de reportes de sospecha de explotación sexual infantil a través de las plataformas digitales; además, el organismo destacó un volumen relevante de reportes “urgentes”.

Thorn, en colaboración con NCMEC, ha analizado más de 15 millones de reportes (2020–2023) para estudiar la sextorsión financiera de menores y su crecimiento.

Estos riesgos graves muestran cómo la regulación propuesta por España no responde a “casos aislados”, sino a una economía criminal digital con métricas de escala industrial.

Delitos facilitados por mensajería y redes: drogas, armas, Telegram

La Agencia de la UE sobre Drogas (EUDA) advierte que vendedores de mercados ilegales diversifican hacia redes sociales y apps de mensajería cifrada, lo que complica su trabajo a las fuerzas de seguridad.

De hecho, análisis de inteligencia financiera/crypto como el último de TRM Lab apunta a que el uso de apps cifradas como Telegram o Signal reducen barreras de entrada para compradores y facilita el comercio fuera de mercados “clásicos” de la dark web.

La literatura académica ratifica y cuantifica (Dewey & Busetti, Easier, faster and safer: The social organization of drug dealing through encrypted messaging apps, 2024) cómo el tráfico de drogas se facilita operativamente mediante apps cifradas, citando explícitamente Telegram como entorno principal de estos mercados delictivos.

La reacción de Europol (Operación RapTor, 2025) anunció 270 detenciones en una ofensiva global contra redes de comercio ilícito online (drogas, armas, falsificaciones), ilustrando el volumen del ecosistema criminal digital, amparado por plataformas como Telegram.

Muchas redes criminales ya no “venden” a la vista en redes abiertas; captan en abierto y cierran la transacción en mensajería (Telegram/otros). Eso hace que la plataforma no sea “el delito”, pero sí la infraestructura necesaria para delinquir.

Extremismo y “agenda ultra”: movilización, propaganda y burbujas

En Alemania, un estudio en JMIR documenta cómo Telegram fue la herramienta central para organizar protestas y cómo ese ecosistema incorporó teorías conspirativas y contenido extremista, al margen del discurso público mainstream.

También una investigación académica reciente (Hohner, Kavahand y Rothut, Analyzing radical visuals at scale: How far-right groups mobilize on TikTok, 2024) aborda cómo grupos de extrema derecha aprovechan las ganchos de usabilidad (affordances) de las plataformas (diseño + difusión + comunidad) para movilizarse, en TikTok, en este caso aplicando estrategias de movilización visual a escala.

En España, la red ‘Deport Them Now’ —un grupo de extrema derecha con presencia internacional— utilizó múltiples canales en Telegram para difundir mensajes de odio, organizar desplazamientos y coordinar “cacerías” de personas migrantes en regiones específicas, como Torre Pacheco.

Estos canales actuaban como punto de encuentro para simpatizantes de organizaciones ultraderechistas y para coordinar acciones concretas en la localidad, lo cual facilitó que grupos llegaran desde otras partes de España a participar en los disturbios.

Un informe del Ministerio de Inclusión destaca que en el periodo crítico se contabilizaron más de 138.000 mensajes de odio y desinformación dirigidos principalmente contra personas originarias del norte de África, muchos de los cuales se originaron o difundieron en Telegram y plataformas afines.

El mismo canal fue cerrado por orden judicial tras incitar claramente a la violencia racista y a los llamados a “cazar” inmigrantes, y uno de los líderes fue detenido y enviado a prisión por delitos de odio. En este caso, se pudo actuar contra uno de los promotores de un delito amplificado por 138.000 ultraderechistas. Uno de 138.000 escuadristas.

Sobre propaganda exterior y canales sancionados, el Centre for Democracy and Rule of Law analizó cómo las restricciones a canales de propaganda rusa sancionados por la Unión Europea se saltaron a través de Telegram y cómo se siguen difundiendo sus contenidos propagandísticos. La UE ve como sus sanciones contra los medios se tornan inefectivas por la acción de las plataformas que no regula.

Estas plataformas permiten micro-medios ideológicos con gran capacidad de captación y coordinación, más difíciles de observar y moderar (especialmente en mensajería y canales). De ahí la propuesta del Gobierno Español de cuantificar el ruido digital para ponerle coto.

En mi investigación doctoral en curso en la Complutense, dirigida por el doctor Fernando Peinado, llevo cuantificados desde octubre de 2025 más de un centenar de bulos, desinformaciones, misinformaciones, fake news y deepfakes sólo en España, sólo en X, y sólo de carácter político, con un coste equivalente agregado de más de 12 millones de euros en impactos. Los esfuerzos por neutralizar estos bulos por parte de periodistas, medios como El Constitucional o verificadores apenas neutralizan parcialmente esos bulos con una equivalencia de 7 millones de euros, el 58%.

En 'El Constitucional' ya dimos cuenta de cómo los bulos sobre el accidente ferroviario de Adamuz alcanzaron a más de 26 millones de personas sólo en X, generando un daño reputacional de 577.398 euros.

La respuesta del Estado: regulación, límites y choque frontal

El Gobierno español ha puesto sobre la mesa tres ideas clave:

- Protección de menores mediante verificación de edad.

- Responsabilidad legal de las plataformas por los contenidos que amplifican.

- Posible responsabilidad personal de los directivos en casos graves de incumplimiento.

No es una ocurrencia aislada. Se inscribe en el marco europeo de la Digital Services Act (DSA), que reconoce explícitamente que las grandes plataformas generan riesgos sistémicos para la democracia, la seguridad y los derechos fundamentales.

La reacción de Musk y Telegram confirma, paradójicamente, el diagnóstico del Gobierno: si no fueran actores políticos reales, no necesitarían reaccionar como tales.

Europa ante una disyuntiva histórica

La Unión Europea se enfrenta a una decisión estratégica:

- Aceptar que estas plataformas son simples intermediarios técnicos, o

- Reconocerlas como infraestructuras de comunicación pública con obligaciones democráticas.

El modelo actual es inestable.

Se exige a un director de periódico responder ante un juez por lo que publica,

pero se permite a una plataforma global influir en procesos políticos sin responsabilidad equivalente, escudándose en la neutralidad tecnológica.

El conflicto entre España y Musk no es un caso anecdótico:

es un ensayo general de lo que ocurrirá en toda Europa en los próximos años, y que Pedro Sánchez ha acelerado con sus medidas anunciadas en Dubai.

Conclusión: regular no es censurar, es democratizar el poder

La pregunta ya no es si hay que regular, sino quién gobierna el espacio público digital:

* ¿Los parlamentos democráticos?

* ¿O consejos de administración en Silicon Valley?

Considerar a X o Telegram como medios de comunicación de facto no implica censura, sino responsabilidad proporcional al poder real que ejercen.

Negar ese poder, a la vista de los hechos, es una forma de ingenuidad política que las democracias europeas no pueden permitirse.

Porque cuando un empresario puede hablar directamente a millones de ciudadanos para desacreditar a un gobierno, el problema no es la regulación.

El problema es no tenerla.